Tren AI Dinilai Bisa Picu Konfrontasi Geoekonomi

Konfrontasi geoekonomi menjadi ancaman global yang paling mendesak dihadapi dunia dalam jangka pendek, menurut laporan Risiko Global 2026 dari WEF. Kecerdasan buatan atau AI dinilai bisa menjadi pemicu konfrontasi geoekonomi.

Laporan Risiko Global 2026 berdasarkan survei terhadap lebih dari 1.300 pakar di seluruh dunia, sebanyak 18% menyatakan konfrontasi geoekonomi menjadi risiko terbesar dalam stabilitas global. Konfrontasi geoekonomi yang dimaksud melibatkan penggunaan perdagangan, investasi, sanksi, dan kebijakan industri sebagai senjata strategis untuk membatasi rival geopolitik dan mengonsolidasikan lingkup pengaruh.

Disusul oleh konflik antarnegara, cuaca ekstrem, polarisasi masyarakat, serta misinformasi dan disinformasi.

“Kenapa AI bisa menjadi risiko terbesar konfrontasi geoekonomi? Konfrontasi ini tidak terlepas dari upaya penguasaan terhadap seluruh ekosistem AI," ujar Direktur Jenderal Ekosistem Digital Kementerian Komunikasi dan Digital atau Komdigi Edwin Hidayat dalam acara diskusi IDE Katadata Future Forum 2026 bertajuk ‘Menuju Visi Kecerdasan Artifisial: Penguatan Tata Kelola AI’ di Jakarta, Rabu (15/4).

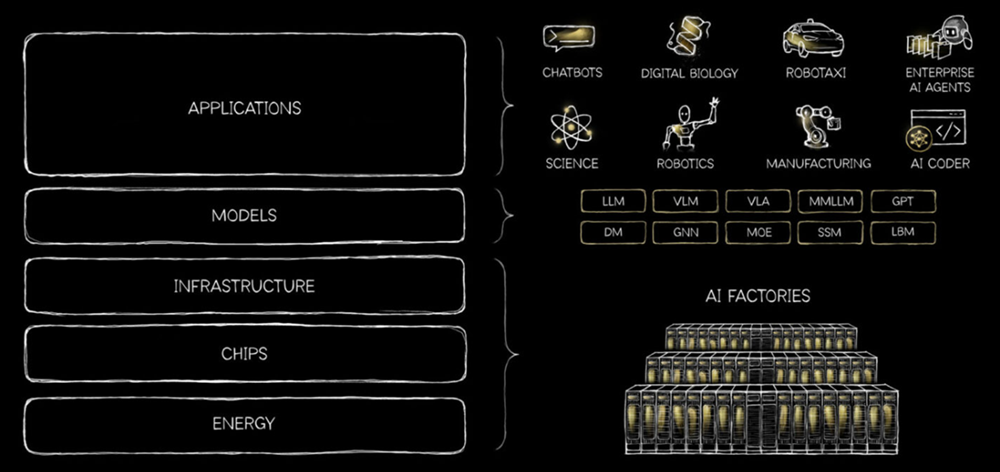

Ia mengutip pernyataan CEO Nvidia Jensen Huang yang diunggah di laman resmi perusahaan, tentang lima lapisan kue yang merujuk pada kecerdasan buatan. Pertama, energi. Kecerdasan yang dihasilkan secara real-time, membutuhkan daya yang dihasilkan secara real-time juga.

“Untuk menguasai AI, itu harus menguasai energi. Energi termasuk (risiko) konfrontasi geoekonomi tidak?” ujar Edwin.

Lapisan kedua, cip yang dirancang untuk mengubah energi menjadi komputasi secara efisien dalam skala besar. Beban kerja AI membutuhkan paralelisme yang sangat besar, memori bandwidth tinggi, dan interkoneksi cepat.

Harga cip bahkan melonjak sejak akhir tahun lalu imbas tren AI. Kondisi ini berdampak terhadap kenaikan harga ponsel, laptop hingga memori.

“Ekosistem semikonduktor ini bisa menciptakan (risiko) konflik geoekonomi tidak? Penguasaan baterai?” Edwin menambahkan.

Pada Oktober 2022 misalnya, BIS atau Bureau of Industry and Security Kementerian Perdagangan AS mengeluarkan aturan komprehensif yang membatasi ekspor semikonduktor canggih dan peralatan manufaktur terkait ke Cina.

AS memblokir akses langsung Cina ke semikonduktor canggih yang dibutuhkan untuk pengembangan AI mutakhir.

Pada Januari 2026, Presiden AS Donald Trump mengeluarkan dua pengumuman berdasarkan Section 232 yang menargetkan risiko keamanan nasional terkait impor mineral kritis yang telah diproses dan semikonduktor. Pengumuman ini menandai perluasan penggunaan otoritas Section 232 untuk membentuk ulang rantai pasokan teknologi yang dianggap penting bagi pertahanan, infrastruktur, dan keamanan ekonomi AS.

Ketiga, infrastruktur, termasuk lahan, penyaluran daya, pendinginan, konstruksi, jaringan, dan sistem yang mengatur puluhan ribu prosesor menjadi satu mesin. Sistem-sistem ini adalah pabrik AI.

Pemerintah AS melalui Executive Order 14117 pada 2024, membatasi transfer data warga dalam jumlah besar ke ‘negara yang menjadi perhatian’, termasuk Tiongkok.

Keempat, model bahasa besar alias large language model. Model AI memahami berbagai jenis informasi, baik bahasa, biologi, kimia, fisika, keuangan, kedokteran, dan dunia fisik itu sendiri.

“Yang mahal bukan modelnya, tetapi data cleansing. Kalau LLM dikuasai dengan data yang dikontrol, apakah bisa menciptakan konflik?”ujar dia.

Terakhir, aplikasi. Platform penemuan obat, robotika industri, asisten hukum, mobil tanpa pengemudi merupakan aplikasi AI yang diwujudkan dalam mesin.

Kekhawatiran Misinformasi di Tengah Tren AI

Misinformasi dan disinformasi menempati peringkat kedua dalam prospek risiko global dua tahun ke depan, sementara ketidakamanan siber menempati peringkat keenam.

Dampak negatif AI menunjukkan lintasan yang paling mencolok, naik dari peringkat ke-30 dalam jangka waktu dua tahun menjadi peringkat ke-5 dalam jangka waktu 10 tahun. Ini mencerminkan kekhawatiran tentang implikasinya terhadap pasar tenaga kerja, masyarakat, dan keamanan.

Di Indonesia, Kementerian Komdigi mengantisipasi risiko ini dengan menyusun rancangan Peraturan Presiden (Perpres) terkait AI. Ada dua yang disiapkan yakni peta jalan AI dan etika.

Edwin menyampaikan bahwa Perpres terkait Peta Jalan AI 2026 – 2029 memberikan arahan dan langkah-langkah pelaksanaan strategi pembangunan ekosistem AI nasional.

Perpres Peta Jalan AI itu memuat bidang spesifik yang akan diarahkan secara strategis dalam pengembangan dan pemanfaatan akal imitasi. Bidang yang dimaksud yakni ekonomi dan keuangan; energi, sumber daya dan lingkungan; kesehatan; ketahanan pangan; pendidikan; pertahanan; perumahan; politik, hukum, dan keamanan; reformasi birokrasi; serta, seni, budaya dan ekonomi kreatif.

Aturan itu juga memuat program hasil terbaik cepat (quick win) dalam pemanfaatan AI, di antaranya untuk Makan Bergizi Gratis (MBG), skrining TBC, pemetaan wilayah rawan stunting, Koperasi Desa (Kopdes), mendukung pembelajaran adaptif sekolah rakyat, serta deteksi hoaks dan disinformasi.

Sedangkan Perpres Etika AI mengatur prinsip moral yang berfungsi sebagai landasan yang memastikan proses pengembangan, penyelenggaraan, dan pemanfaatan AI degan nilai etika yang ditetapkan.

Pengembangan, penyelenggaraan, dan pemanfaatan AI akan berpedoman pada nilai Pancasila, UUD NRI 1945, peraturan perundang-undangan, serta etika AI. Nilai etika AI yakni inklusivitas, kemanusiaan, keamanan, aksesibilitas, transparansi, kredibilitas dan akuntabilitas, pelindungan data pribadi, pembangunan dan lingkungan berkelanjutan, serta kekayaan intelektual.

Perpres Etika AI juga membagi risiko AI dalam tiga kategori. Pertama, risiko rendah. “Misalnya chatbot Rumah Sakit,” kata Edwin.

Kedua, risiko tinggi, yakni apabila akal imitasi menggunakan data pribadi bersifat spesifik sesuai ketentuan perundang-undangan, dan/atau berdampak signifikan terhadap Hak Asasi Manusia (HAM), keselamatan, layanan publik penting, dan berpotensi menimbulkan kerugian serius bagi individual dan kelompok tertentu apabila terjadi kesalahan, penyalahgunaan, dan/atau kegagalan sistem.

Terakhir, risiko yang tidak dapat diterima, yakni apabila AI dianggap mengancam dan membahayakan keselamatan pengguna, HAM, dan/atau berdampak luas terhadap keamanan publik dan stabilitas nasional.

Etika AI itu harus dipatuhi oleh pengguna, pelaku sektor, kementerian/;lembaga, dan pemangku kepentingan lainnya.

“Kementerian dan lembaga harus membuat kebijakan AI masing-masing. Ini yang membuat jadi ‘ramai’, karena aturan teknis di setiap regulator akan berbeda,” kata Edwin. Ia mencontohkan penggunaan akal imitasi di industri media. “Berapa persen penggunaan AI-nya. Saat ini diatur oleh perusahaan masing-masing.”