Ketika AI Bikin Penipu dan Hacker Makin Canggih, Zero Trust Bisa Jadi Solusi

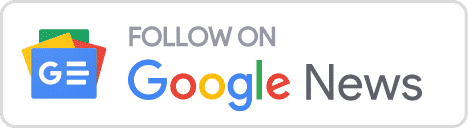

Di Indonesia, ada tren edit foto berbasis AI dan aplikasi pengenalan wajah. Apakah ini bisa digunakan untuk penipuan berbasis AI?

Saat ini, kami melihat peningkatan besar dalam praktik credential stuffing, yaitu ketika pelaku kejahatan siber mengumpulkan data pribadi dalam jumlah besar, lalu menjual atau memanfaatkannya untuk menyerang sistem lain.

Kasus seperti ini sudah banyak terjadi di berbagai negara, termasuk di Australia, di mana informasi identitas penting yang selama bertahun-tahun kita gunakan kini tersebar luas di dunia maya.

Akibatnya, para pelaku bisa dengan mudah meniru identitas seseorang, bahkan meyakinkan petugas di pusat bantuan agar memberikan akses tertentu.

Masalah ini akan menjadi lebih kompleks jika biometrik mulai disalahgunakan. Sebab, data semacam itu jauh lebih sulit diubah dibandingkan kata sandi. Maka dari itu, kita perlu kembali menegakkan pilar-pilar utama dalam sistem identitas, terutama prinsip zero-trust.

Prinsip zero-trust berarti tidak ada entitas, baik di dalam maupun di luar jaringan, yang langsung dipercaya.

Jika risiko pencurian identitas dan penyalahgunaan data semakin meningkat, kita tidak cukup hanya memverifikasi siapa pengguna itu, tapi juga memantau perilaku mereka di dalam sistem. Misalnya:

- Apakah mereka mengakses sistem yang memang seharusnya mereka buka?

- Apakah perilaku mereka sesuai dengan pola normal penggunaan data?

- Apakah ada indikasi payload berbahaya atau tanda serangan yang terdeteksi sistem keamanan (IPS signature)?

Semua aktivitas tersebut perlu diawasi secara berlapis. Jika ditemukan perilaku yang mencurigakan atau melanggar aturan, sistem harus segera membatasi akses, menghentikan aktivitas, dan memverifikasi ulang identitas pengguna.

Artinya, identitas tidak bisa dijadikan satu-satunya benteng keamanan. Kita perlu menggabungkannya dengan seluruh prinsip zero-trust lainnya, seperti pemantauan berkelanjutan, validasi perilaku, dan pembatasan hak akses, agar sistem tetap aman. Langkah ini semakin penting karena erosi identitas digital akan terus terjadi seiring meningkatnya kebocoran dan penyalahgunaan data pribadi.

Bagaimana kesiapan regulasi, SDM, dan teknologi Indonesia mengantisipasi serangan siber dan penipuan berbasis AI?

Tren AI dan berbagai kemampuan yang muncul bersamanya, akan secara signifikan meningkatkan cara para pelaku kejahatan siber beroperasi. Mereka akan semakin kreatif dalam memanfaatkan teknologi ini untuk mencapai tujuan mereka, dan AI akan menjadi alat yang sangat kuat untuk membantu mereka melancarkan serangan dengan cara yang lebih cepat, lebih efisien, dan lebih sulit dideteksi.

Namun, bagaimana tepatnya hal itu akan berkembang masih sulit diprediksi. Dunia siber selalu berubah dengan cepat, dan kita baru akan benar-benar melihat dampaknya seiring waktu berjalan.

Jadi, dalam banyak hal, kita masih menunggu dan melihat bagaimana para penyerang akan terus berinovasi menggunakan AI.

Kementerian Komdigi sedang menyusun peta jalan AI. Adakah rekomendasi untuk regulasi AI di Indonesia?

Saya pikir hal terpenting yakni memastikan adanya kolaborasi erat antara sektor publik dan swasta, serta kemampuan semua pihak untuk saling memberi masukan dan perspektif yang konstruktif. Kemitraan semacam ini menjadi kunci agar kita dapat menghadapi perkembangan teknologi dengan pendekatan yang menyeluruh dan adaptif.

Jika melihat contoh di Australia, kami telah mengembangkan peta jalan strategis dalam beberapa tahun terakhir. Ada berbagai uji coba dan bukti konsep yang dilakukan bersama sejumlah vendor untuk memperkaya kebijakan tersebut, disertai dengan proses konsultasi publik yang sangat luas. Langkah ini memastikan bahwa berbagai pandangan dan kepentingan dapat diakomodasi.

Saya percaya, pendekatan seperti itu sangat penting karena tidak ada satu pun yang benar-benar tahu ke mana arah perkembangan teknologi ini akan membawa kita. Yang jelas, perubahan ini akan mengubah dunia secara mendasar, sama seperti revolusi industri yang pernah terjadi di masa lalu.

Kita mungkin tidak selalu berhasil dalam setiap langkahnya, tetapi melibatkan sebanyak mungkin pihak dalam proses kolaborasi dan konsultasi adalah kunci untuk menghadapi masa depan dengan lebih siap dan seimbang.

Pertanyaan penting yang perlu diajukan oleh setiap organisasi adalah alat AI apa yang paling nyaman dan tepat untuk digunakan? Apakah itu ChatGPT, Gemini, atau model internal yang dikembangkan sendiri oleh perusahaan? Setelah itu, penting juga untuk memahami tujuan penggunaannya, apakah untuk melakukan kueri (pencarian dan analisis cepat), menulis materi pemasaran, atau bahkan memproses data sensitif.

Kita harus jelas tentang untuk apa seharusnya alat-alat tersebut digunakan? Selain itu, organisasi perlu menetapkan batasan mengenai data apa saja yang boleh dimasukkan ke dalam sistem AI.

Banyak perusahaan yang memulai perjalanan AI dengan langkah sederhana seperti ini: “kami telah membeli model AI dari vendor tertentu. Anda boleh mengajukan pertanyaan atau melakukan kueri untuk membantu pekerjaan Anda menjadi lebih efisien. Namun, Anda tidak diperbolehkan memasukkan data internal perusahaan atau informasi sensitif ke dalam sistem tersebut.”

Jadi, sejak awal, organisasi harus mendefinisikan dengan jelas:

- Model AI apa yang digunakan,

- Siapa saja pengguna yang memiliki akses, dan

- Jenis data apa yang aman untuk diolah di dalamnya.

Ketiga hal itu merupakan fondasi dasar yang harus ditetapkan sebelum memulai perjalanan penerapan AI di lingkungan perusahaan. Dengan begitu, organisasi dapat memanfaatkan potensi AI secara maksimal tanpa mengorbankan keamanan dan integritas data mereka.

Bagaimana regulasi AI di Australia?

Ada sejumlah langkah, misalnya Pusat Keamanan Siber Australia atau ACSC menerbitkan panduan arsitektur dan teknis yang sangat komprehensif dalam 12 hingga 24 bulan terakhir. Panduan ini berisi berbagai pertimbangan penting dalam membangun dan mengintegrasikan sistem AI ke dalam organisasi.

Namun, panduan ini bukanlah kebijakan wajib yang harus diikuti. Melainkan berupa praktik terbaik, rekomendasi, dan saran bagi pasar untuk membantu mereka menavigasi penerapan AI di tengah kekosongan standar regulasi global.

Saat ini, standar seperti ISO 42001 memang masih dalam tahap awal perkembangan. Oleh karena itu, panduan dari ACSC menjadi sangat berguna bagi para anggota dewan dan pimpinan organisasi. Mereka dapat menjadikannya acuan untuk mulai membangun kerangka tata kelola AI dan strategi mitigasi risiko di tingkat dewan.

Beberapa organisasi bahkan telah mengambil langkah proaktif dengan membentuk struktur tata kelola dan manajemen AI internal, meskipun belum ada aturan yang sepenuhnya jelas. Langkah ini memungkinkan perusahaan menyusun dokumentasi dan pedoman internal, agar mereka dapat mengomunikasikan secara terbuka “ya, kami berkomitmen mengadopsi AI. Kami akan melakukannya dengan tingkat risiko yang bisa diterima, dan penerapannya akan mencakup aktivitas-aktivitas tertentu.”

Ke depan, panduan dan kebijakan ini akan terus diperbarui seiring perkembangan situasi dan keluarnya arahan resmi yang lebih jelas dari pemerintah. Menurut saya, pendekatan seperti ini sangat bermanfaat dalam membantu organisasi bersiap menghadapi era AI dengan cara yang aman dan bertanggung jawab.

Adakah rekomendasi kurikulum pendidikan di Indonesia agar siap menghadapi era AI?

Palo Alto Networks mengumumkan program bernama CyberLite, yaitu inisiatif yang berfokus pada pendidikan dan literasi terkait AI generatif di semua tingkatan. Program ini menjadi salah satu pilar utama dalam strategi keamanan mereka.

Kemampuan untuk memberikan pelatihan secara luas kepada seluruh karyawan ini penting. Artinya, organisasi harus mampu menjelaskan kepada para pegawai, “apa itu AI generatif, apa risikonya, dan bagaimana cara melindungi diri dari potensi ancamannya”.

Langkah ini sama pentingnya seperti pelatihan keamanan siber yang kita kenal sebelumnya, seperti pelatihan dasar tentang phishing, keamanan email, atau cara mengenali serangan siber sederhana. Prinsipnya sama: edukasi dan latihan berulang dapat memperkuat kewaspadaan dan kesiapan organisasi.

Setelah memberikan pemahaman dan pelatihan yang tepat, langkah berikutnya adalah berlatih secara nyata. Artinya, jangan hanya memberi informasi, tetapi juga menerapkan dan mempraktikkan langkah-langkah keamanan yang sudah diajarkan. Dengan begitu, budaya keamanan dan kesadaran terhadap risiko AI dapat benar-benar tertanam dalam perilaku seluruh anggota organisasi.

Palo Alto Networks juga memiliki program CyberSafe Kids, salah satu inisiatif untuk mengedukasi anak-anak dan orang tua tentang cara menggunakan AI dan perangkat teknologi digital secara cerdas. Ini sudah diterapkan di Indonesia.

Palo Alto Networks telah menjalin kolaborasi dengan universitas di Indonesia. Ini salah satu rencana besar, inisiatif, dan komitmen jangka panjang yang dimiliki Palo Alto Networks untuk pendidikan semacam ini.

Masukan saya, ada modul tentang teknologinya, bagaimana cara menggunakannya, dan apa saja risikonya.

Jadi, sebenarnya kita tidak boleh membatasi atau melarang penggunaan teknologi digital atau standar dari anak-anak. Akan tetapi, pada titik tertentu, kita perlu mendorong mereka untuk menggunakan perangkat secara cerdas.

Bukan hanya anak-anak, tetapi juga organisasi. Kita ingin memiliki alat yang hebat dan ampuh ini, tetapi di saat yang sama kita tidak ingin membiarkan semua orang menggunakannya untuk segala hal. Ada keseimbangan antara tidak menggunakannya dan membiarkan kita melakukan segalanya, baik itu anak-anak maupun di mana pun.

Itulah mengapa saya mengatakan bahwa kerangka kerja tata kelola tentang bagaimana kita akan menggunakannya, siapa yang dapat menggunakannya, untuk metode apa dan data apa yang dapat kita masukkan ke dalamnya sangatlah penting.

Jika Anda telah mendefinisikannya, langkah selanjutnya adalah bagaimana saya memastikan bahwa tata kelola benar-benar terjadi dan sekarang tersedia alat untuk melakukannya. Perhatikan interaksi antara pengguna dan model, lalu data yang digunakan, dan pastikan semuanya dilakukan dengan tepat sesuai dengan tata kelola.

Semua hal itu adalah kuncinya.