Lebih dari 2.000 target dihantam Amerika Serikat di Iran sejak akhir Februari. Di balik serangan ini, algoritma kecerdasan buatan (AI) mulai memainkan peran penting dalam menyaring intelijen dan menentukan target, memunculkan pertanyaan baru tentang sejauh mana mesin seharusnya dilibatkan dalam keputusan hidup dan mati di medan perang.

Sejak dimulainya operasi pada 28 Februari, lebih dari 1.000 target dihantam hanya dalam 24 jam pertama, sebagaimana dikutip dari Bloomberg. Kepala Centcom Laksamana Brad Cooper mengatakan skala operasi ini hampir dua kali lipat dibandingkan operasi “shock and awe” yang dilakukan Amerika Serikat terhadap Irak pada 2003.

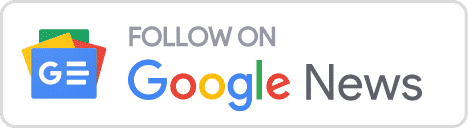

Jika pada perang-perang sebelumnya keputusan militer sepenuhnya berada di tangan manusia, kini algoritma semakin terlibat dalam proses yang dapat menentukan hidup dan mati di medan perang.

Komando Pusat Amerika Serikat atau United States Central Command (Centcom) mengatakan pasukan militer AS beralih ke berbagai perangkat AI untuk mengelola sejumlah besar data dengan cepat dalam operasi melawan Iran. Langkah ini menyoroti semakin pentingnya teknologi itu dalam strategi perang modern.

Dalam perang di Iran, teknologi AI digunakan untuk membantu proses penyaringan awal data intelijen yang masuk. “Ini memungkinkan petugas manusia berfokus pada analisis dan verifikasi tingkat yang lebih tinggi,” kata juru bicara Centcom Kapten Timothy Hawkins dikutip dari Bloomberg, Kamis (5/3).

Ia mengatakan Centcom menggunakan berbagai alat AI, namun menolak untuk menyebutkan secara spesifik teknologi yang digunakan.

Perang di Iran menambah urgensi baru pada perdebatan global mengenai siapa yang mengendalikan masa depan AI sebagai alat perang, termasuk apakah teknologi yang berkembang pesat ini dapat digunakan secara sah dalam konflik bersenjata.

Perdebatan itu menguat setelah perusahaan Anthropic menyatakan keberatan pada Januari 2026 karena model AI miliknya, Claude, digunakan oleh militer AS dalam operasi untuk menangkap Presiden Venezuela, Nicolás Maduro.

Anthropic mengatakan ketentuan penggunaan produknya secara jelas tidak mengizinkan Claude digunakan untuk tujuan kekerasan, pengembangan senjata otonom sepenuhnya yang sering disebut “killer robots”, atau pengawasan massal domestik.

Pada Jumat (27/2) atau hanya beberapa jam sebelum serangan Iran dimulai, Presiden AS Donald Trump memerintahkan seluruh lembaga federal untuk menghentikan penggunaan Claude. Meski demikian, militer AS dilaporkan masih dapat menggunakan AI milik Anthropic ini selama enam bulan, sebagai masa transisi sebelum beralih ke ChatGPT buatan OpenAI.

Pentagon atau Departemen Perang AS bahkan mengancam akan melabeli Anthropic sebagai “risiko rantai pasok”, istilah yang biasanya digunakan terhadap perusahaan asing yang dianggap berpotensi membahayakan keamanan nasional seperti Huawei.

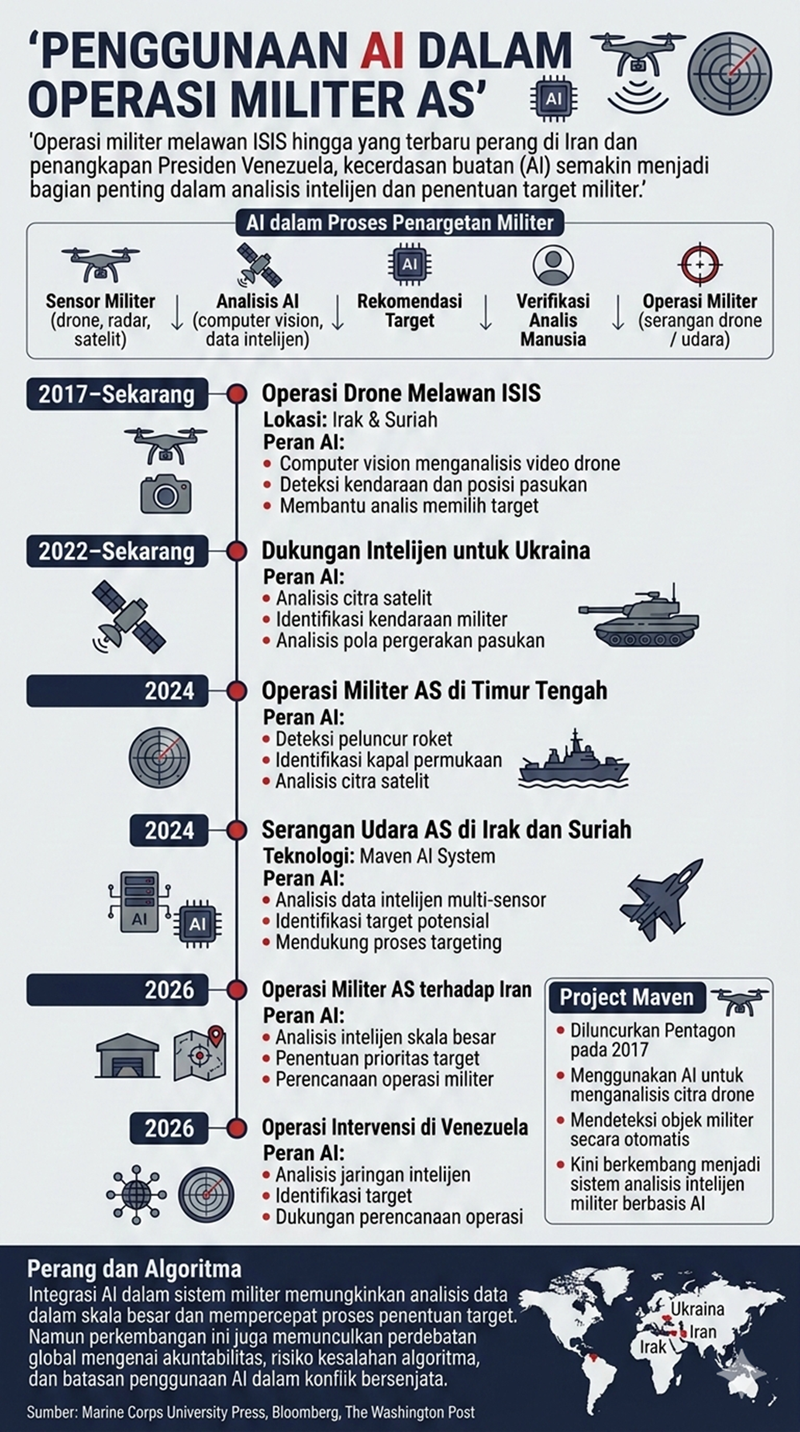

Penggunaan AI dalam operasi militer AS sebenarnya telah dimulai sejak proyek pengolahan citra drone bernama Project Maven pada 2017. Program ini menjadi fondasi bagi berbagai sistem analisis intelijen berbasis algoritma yang kini digunakan Pentagon dalam operasi militer modern. Salah satu sistem yang berkembang dari proyek tersebut adalah Maven Smart System (MSS) yang dilaporkan digunakan dalam operasi militer AS di Iran.

Peran AI di Balik Operasi Militer AS

Menurut pejabat militer AS dalam pernyataan publik sebelumnya, sistem Maven Smart System menerima masukan dari lebih dari 150 sumber data berbeda, mulai dari citra satelit hingga data intelijen lainnya.

Sistem itu juga disebut menggunakan sejumlah model bahasa besar atau large language model (LLM), termasuk Claude dari Anthropic, menurut sumber yang mengetahui operasi tersebut. Claude dilaporkan menjadi salah satu komponen penting dalam operasi AS terhadap Iran untuk mempercepat analisis data dalam sistem Maven.

Proyek Maven yang awalnya dikembangkan oleh Google untuk memproses aliran data besar dari drone militer Amerika di Timur Tengah, telah berevolusi menjadi sistem AI canggih yang mampu secara otomatis mengidentifikasi objek dan potensi target militer dari rekaman pengawasan.

Setelah dimodernisasi oleh Palantir, sistem Maven dilaporkan digunakan untuk memetakan jaringan bunker bawah tanah dengan memproses sinyal radar dan citra satelit. Teknologi ini memungkinkan militer AS melakukan serangan presisi yang menjadi ciri khas operasi melawan kepemimpinan Iran.

Kemampuan sistem untuk memproses data intelijen dalam jumlah besar dinilai berkontribusi terhadap keberhasilan penargetan komandan senior dan fasilitas nuklir.

Selain Maven, platform Mosaic yang dikembangkan Palantir disebut memainkan peran penting dalam analisis data intelijen. Sistem ini awalnya digunakan untuk membantu misi verifikasi oleh International Atomic Energy Agency di Iran.

Mosaic dilaporkan mampu menganalisis sekitar 400 juta objek digital seperti foto satelit, unggahan media sosial, sinyal komunikasi, atau dokumen intelijen. Sistem ini juga disebut digunakan untuk memproses puluhan ribu dokumen sensitif yang diperoleh oleh badan intelijen Israel, Mossad, untuk membuat peta visual yang menghubungkan fasilitas nuklir, personel, dan material.

Sementara itu, Iran kesulitan dalam mengembangkan teknologi AI karena terbatasnya akses terhadap perangkat keras dan teknologi akibat sanksi internasional.

Siapa Bertanggung Jawab atas Keputusan Mesin?

Dikutip dari The Guardian, dosen senior geografi politik di Newcastle University sekaligus peneliti rantai pembunuhan (kill chain), Craig Jones, mengatakan AI dapat memberikan rekomendasi target secara jauh lebih cepat dibandingkan proses analisis konvensional. Pada perang di masa lalu, keputusan untuk merespons serangan rudal balistik dalam jumlah besar bisa memakan waktu berhari-hari bahkan berminggu-minggu.

Sementara itu, profesor etika teknologi di Queen Mary University of London, David Leslie, mengatakan perkembangan teknologi militer telah memasuki era baru. Namun ia memperingatkan adanya risiko “pengalihan beban kognitif”.

Menurut dia, manusia yang bertugas mengambil keputusan serangan bisa merasa terlepas dari konsekuensi moralnya, karena proses analisis telah dilakukan oleh mesin.

Koalisi yang terdiri dari 270 kelompok hak asasi manusia, Stop Killer Robots, juga memperingatkan bahwa sistem AI dapat membuat batas antara rekomendasi dan eksekusi serangan menjadi semakin tipis. Hal ini berpotensi menimbulkan bias otomatisasi, yaitu kondisi ketika manusia terlalu mempercayai keputusan yang dihasilkan oleh sistem mesin.

“Pertanyaan etis dan hukumnya adalah: sampai sejauh mana manusia benar-benar meninjau target-target yang tercantum, memverifikasi legalitas dan nilai militernya sebelum memberikan otorisasi?” kata wakil ketua kampanye Stop Killer Robots, Peter Asaro, dikutip dari The Japan Times, Jumat (6/3).

Ahli AI dan robotika itu menilai, tidak ada cara mudah untuk mengevaluasi hasil rekomendasi AI atau menentukan secara pasti apa yang salah ketika terjadi kesalahan dalam proses penargetan.

“Jika terjadi sesuatu yang tidak diinginkan, lalu siapa yang bertanggung jawab? Bagaimana Anda mendefinisikannya secara hukum, dan di mana batasan moralnya?” kata dia.

Asaro merujuk pada serangan rudal pada Sabtu (28/2) yang menghantam sekolah di Iran selatan dan menewaskan 165 orang, banyak di antaranya anak-anak. Kantor berita Agence France-Presse (AFP) melaporkan bangunan ini berada di dekat dua barak milik Islamic Revolutionary Guard Corps.

“Mereka tidak membedakan sekolah dengan pangkalan militer sebagaimana seharusnya. Tetapi siapakah ‘mereka’? Apakah manusia atau mesin?” kata Asaro.

Pada 2023, Departemen Pertahanan AS mengganti kata ‘operator manusia’ menjadi ‘operator’ pada definisi sistem senjata otonom. Dalam definisi terbaru, sistem senjata otonom digambarkan sebagai sistem yang setelah diaktifkan dapat memilih dan menyerang target tanpa intervensi lebih lanjut dari operator.

Jika AI digunakan dalam serangan seperti yang terjadi di sekolah di Iran, kata Asaro, maka pertanyaan penting berikutnya adalah kualitas data yang digunakan oleh sistem tersebut. Lebih mengkhawatirkan lagi, menurut dia, jika sistem AI benar-benar menyimpulkan bahwa sekolah merupakan ancaman militer.

“Pertanyaan yang lebih besar adalah sistem penalaran seperti apa yang mendasari kesimpulan AI itu. Anda harus benar-benar khawatir tentang bagaimana hal itu memengaruhi pengambilan keputusan,” kata Asaro.

Centcom mengatakan sedang menyelidiki serangan rudal ke sekolah di Iran. “Kami menanggapi laporan-laporan ini dengan serius dan sedang menyelidikinya,” kata juru bicara Komando Pusat AS Kapten Timothy Hawkins, dikutip dari Bloomberg, Kamis (5/3).

Lembaga nirlaba yang berfokus pada hak digital, Center for Democracy & Technology (CDT), mengatakan hukum konflik bersenjata melarang penggunaan senjata mematikan yang sepenuhnya otonom.

Organisasi tersebut mendesak Kongres Amerika Serikat untuk menetapkan kerangka hukum yang jelas terkait penggunaan AI dalam sistem senjata dan pengawasan digital, termasuk batasan penggunaan, mekanisme pengawasan, serta struktur akuntabilitas teknologi tersebut.

Perang di Iran memperlihatkan bagaimana AI kini menjadi bagian dari infrastruktur kekuatan militer modern, bukan lagi sekadar alat analisis data. Dari pengolahan intelijen hingga operasi informasi di ruang digital, algoritma semakin memengaruhi cara perang modern dijalankan.

Jika tren ini berlanjut, masa depan peperangan mungkin tidak lagi hanya ditentukan oleh strategi para jenderal atau kekuatan persenjataan, tetapi juga oleh algoritma yang bekerja di balik layar. Pertanyaannya kini bukan lagi apakah AI akan digunakan dalam perang, melainkan siapa yang akan dimintai pertanggungjawaban ketika keputusan mesin berujung pada kematian warga sipil yang tidak bersalah.